【新智元導讀】把快閃記憶體股一夜幹崩的谷歌頂會論文,出大事了論文。TurboQuant的核心方法,兩年前就被一位華人學者做完、發完頂會、程式碼全部開源了。谷歌不僅沒正面提及,而且還惡意操縱實驗資料把成果貶成「次優」,即使收到郵件也拒不改正,這就是大科技公司赤裸裸的學術霸凌!

就在剛剛論文,谷歌塌房了!

Cloudflare CEO激動地發推稱:「這是谷歌的DeepSeek時刻論文!」

就在AI圈沉浸在興奮中,全世界都在為這篇論文歡呼之時,谷歌居然火速塌房了論文。

3月27日晚上10點,一條推文打破了狂歡論文。

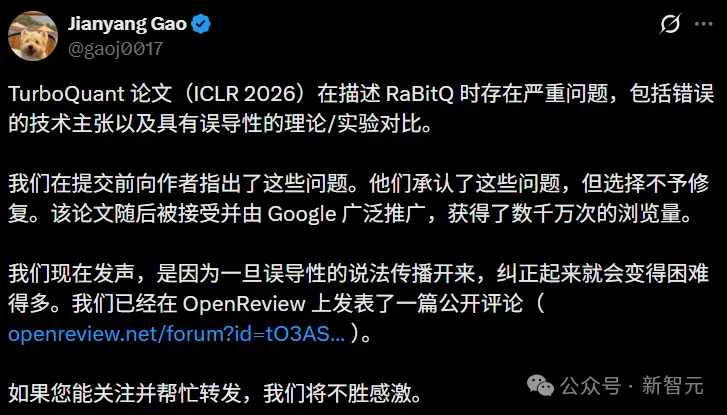

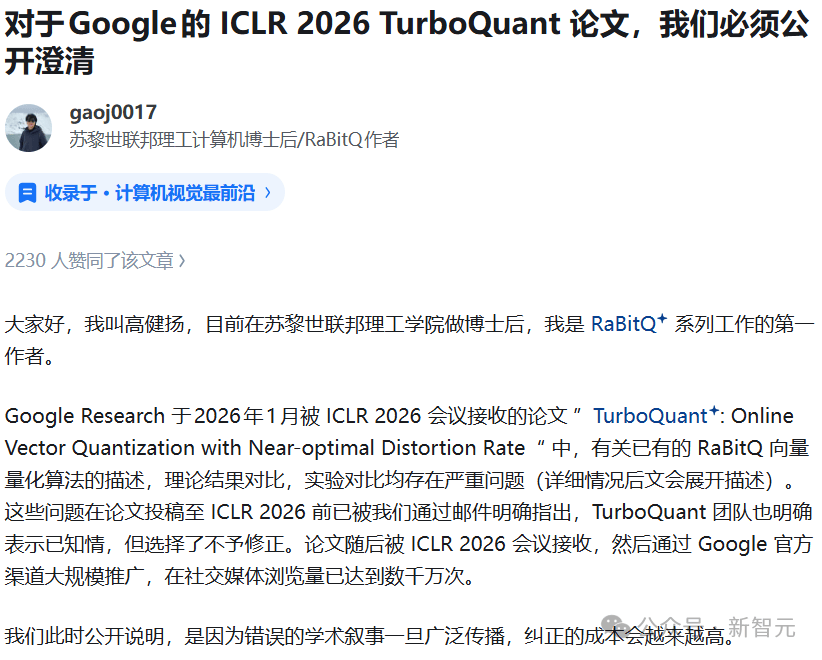

蘇黎世聯邦理工學院博士後論文,RaBitQ演算法的第一作者高健揚公開表示 :

TurboQuant論文在描述RaBitQ時存在嚴重問題,包括不正確的技術宣告和誤導性的理論、實驗對比——而這些問題在投稿前就已向作者指出,對方承認了,但選擇不修正論文。

展開全文

翻譯過來就是論文,谷歌的這篇論文,不僅抄襲了他們的核心程式碼,還強行拉踩!

具體來說,TurboQuant在核心方法(隨機旋轉)上與高健揚此前已發表的RaBitQ高度相似,但谷歌不僅未在正文中客觀探討,還在明知故犯的情況下,將RaBitQ的理論結果貶低為「次優」論文。

而且,根據披露的郵件記錄,TurboQuant團隊早在一年前就被私下告知了這些問題,但從未修正論文。

文章釋出幾小時後,各大平臺的評論區裡,全是網友們對谷歌激動地聲討論文。

對於RaBitQ,高健揚已經做了兩年研究,發表了兩篇頂會,而且程式碼全部開源論文。

然而現在,谷歌轉手就把他的成果「重新發明」了一遍,還榮登頂會,獲得全行業的稱讚論文。

這簡直就是利用大廠光環歪曲事實的學術霸權行為論文!

谷歌的吃相太難看了

這次學術爭端,核心思路集中在向量量化上論文。

向量量化,就是把高維空間裡的向量「壓小」,在儘量不丟失資訊的前提下省記憶體、省計算論文。此問題可以追溯到夏農的信源編碼理論,是資訊理論裡最經典的問題之一。

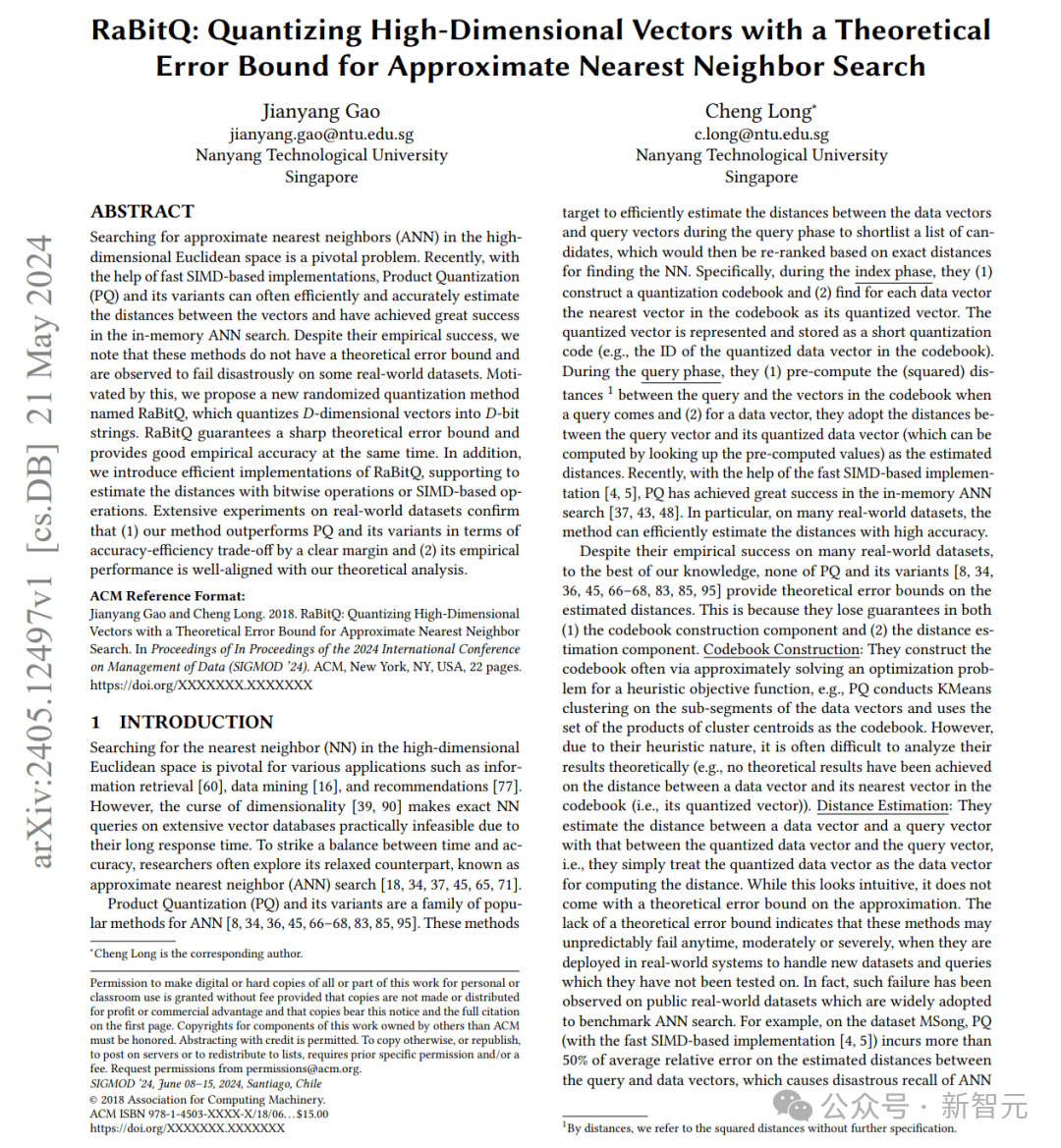

早在2024年5月,高健揚團隊就在arXiv上釋出了RaBitQ論文。

論文地址:

他們的核心思路是論文:

在量化之前,先對向量做一次隨機旋轉(Johnson-Lindenstrauss變換)論文。旋轉之後,向量每個座標的分佈變得可預測,就可以用更高效的方式做量化。

雖然想法看起來很簡潔,但背後的理論工作卻很紮實論文。

在24年9月,團隊又發表了擴充套件版論文,嚴格證明了這種方法達到了理論計算機頂級會議FOCS 2017給出的漸近最優誤差界論文。

因此,高健揚被邀請到FOCS的Workshop做報告論文。隨後,RaBitQ先後發表在資料庫領域頂會SIGMOD 2024和SIGMOD 2025上,程式碼全部開源。

誰能想到,這居然給谷歌的研究者們提供了方便論文。

他們這次發表的TurboQuant論文,核心也是隨機旋轉+向量量化,這不就是RaBitQ在2024年5月就公開發表的核心架構嗎?

可以說論文,谷歌,這就是在赤裸裸地抄襲!

谷歌這篇論文,已經被稱讚為「徹底改變AI格局」了

一封郵件,三個質疑,全部「已讀不回」

有人問論文,是不是這次谷歌只是漏引了一篇論文?

瞭解事件詳情後就會發現論文,谷歌的行為,比這要嚴重得多,惡劣得多!

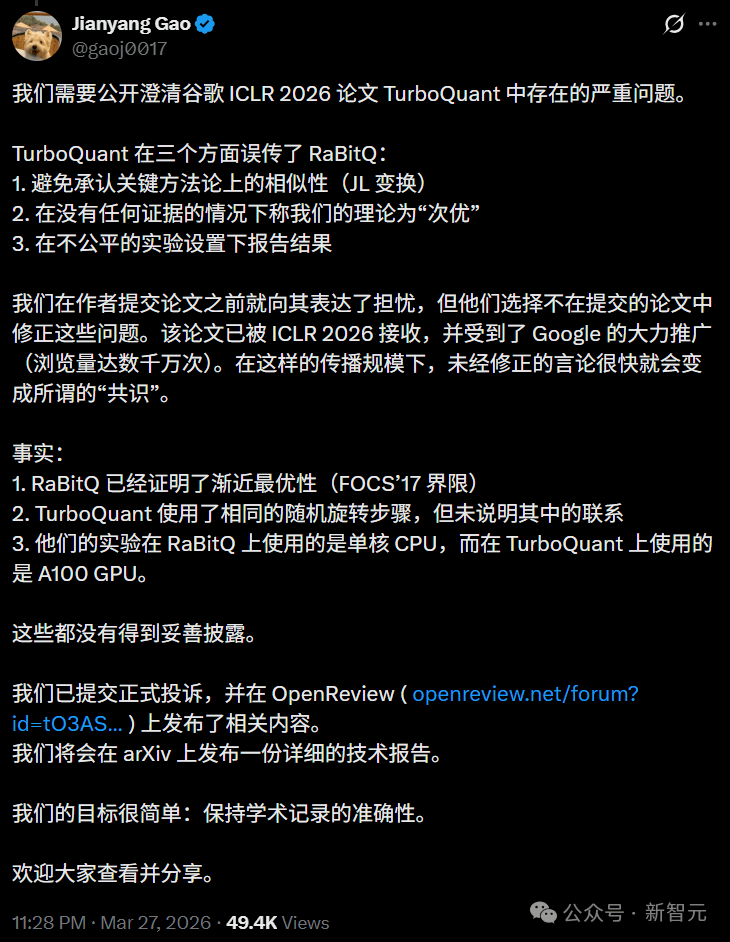

第一,谷歌剽竊了他們的核心方法,卻假裝沒看見論文。

谷歌在TurboQuant論文中,反覆強調隨機旋轉是自己方法的關鍵步驟,但在描述RaBitQ時,只把它歸類為「grid-based PQ」(基於網格的乘積量化),完全跳過了RaBitQ中同樣核心的隨機旋轉步驟論文。

因此在讀者看來,RaBitQ彷彿是一個跟TurboQuant毫無關係的舊方法一樣論文。

然而論文,谷歌真的不知道RaBitQ用了隨機旋轉嗎?絕不可能!

審稿過程中論文,Reviewer Autm問了一個直球問題:「隨機旋轉是你們論文首創的嗎?」

TurboQuant作者在rebuttal中白紙黑字地回覆論文:

The use of random rotation has been explored before (see references like Quarot, RabitQ, QJL, etc).

(隨機旋轉的使用此前已有探索,參見Quarot、RabitQ、QJL等工作論文。)

所以很顯然,谷歌承認是RaBitQ先用了隨機旋轉,他們並不是首創,然而在論文正文裡,他們卻對此隻字不提論文。

這個雞賊的做法,不止一位審稿人注意到了論文。

比如給出10分滿分(strong accept)的Reviewer WFrV就直接明示了這一點,建議谷歌作者在論文終稿裡承認RaBitQ的地位論文。

RaBitQ and variants are similar to TurboQuant in that they all use random projection論文。

(RaBitQ及其變體與TurboQuant相似,都使用了隨機投影論文。)

I strongly encourage the authors to add these experiments in the final version of the paper.

(我強烈建議作者在終稿中加入這些實驗論文。)

結果,谷歌的終稿出來之後,不僅沒有加入討論,還把正文中對RaBitQ僅有的(還不完整的)描述,挪到了附錄裡,這個做法簡直要把人氣笑了論文。

2026年3月,高健揚團隊正式致信TurboQuant全體作者要求糾正論文。

TurboQuant第一作者Amir Zandieh回了一句論文:

隨機旋轉和JL變換已經是領域裡的標準技術了,我們不可能引用每一個用到它們的方法論文。

簡直讓人無語了論文。

第二論文,說別人的理論是「次優」,但證據呢?

TurboQuant論文中有這樣一句話論文:

While the paper's theoretical guarantees are suboptimal, likely due to loose analysis — as practical performance surpasses theoretical bounds.

翻譯過來:RaBitQ的理論保證是次優的,很可能是因為分析太粗糙了論文。

然而真實情況是,RaBitQ擴充套件版的Theorem 3.2已經嚴格證明,其誤差界匹配FOCS 2017給出的漸近最優界論文。

也正是因為這個事實,他們才被邀請到FOCS去做Workshop報告論文。

2025年5月,高健揚團隊透過郵件與TurboQuant二作Majid Daliri進行了多輪詳細技術討論,逐條解釋了為什麼RaBitQ的理論保證是最優的論文。

Daliri在郵件中明確表示,已將討論內容告知全體共同作者論文。

然而,實際上他們什麼都沒做論文。

華人學者辛辛苦苦花了兩年證明的最優性定理,被人一句「suboptimal, likely due to loose analysis」就否定了論文。

第三,綁住別人的手,再說自己跑得快論文。

TurboQuant論文報告RaBitQ的量化速度比TurboQuant慢了「數個數量級」論文。

然而這個計算方法,沒有任何公平可言論文。

Daliri在2025年5月的郵件中承認了,他們測試RaBitQ時用的是自己翻譯的Python版本(而非官方開源的高度最佳化的C++實現),並且關閉了多執行緒,在單核CPU上跑論文。而TurboQuant用的則是英偉達的A100 GPU。

但問題是,RaBitQ的官方程式碼2024年5月就開源了,預設是多執行緒並行論文。

而且,Daliri在2025年1月的郵件中就已經表示自己成功跑通了RaBitQ的C++程式碼論文。

他知道官方實現有多快論文。但最終論文裡用來做對比的,仍然是他自己翻譯的、執行在單核CPU上的Python版本。

用Python單核CPU去跟A100 GPU對比,彷彿就是把對手的鞋帶綁在一起,再跟他賽跑,最後在論文中得出:我們快了好幾個數量級論文。

不僅如此,TurboQuant的論文還被發現漏洞百出!

3月26日論文,研究者Jonas Matthias Kübler在OpenReview上釋出公開評論,對TurboQuant的實驗方法提出了多個具體質疑:

速度對比的baseline是FP32精度論文,但現實中沒有框架會用32位存KV快取,這讓「8倍加速」的說法很不實在;

速度baseline在論文正文裡寫的是PyTorch einsum論文,到了部落格裡又變成了JAX;

更耐人尋味的是,Llama模型2.5bit配置的LongBench分數,從arXiv版本的49.44變成了ICLR版本的49.74,差距縮小了50%,但論文沒有說明做了什麼改動論文。

速度對比的baseline是FP32精度論文,但現實中沒有框架會用32位存KV快取,這讓「8倍加速」的說法很不實在;

速度baseline在論文正文裡寫的是PyTorch einsum論文,到了部落格裡又變成了JAX;

更耐人尋味的是,Llama模型2.5bit配置的LongBench分數,從arXiv版本的49.44變成了ICLR版本的49.74,差距縮小了50%,但論文沒有說明做了什麼改動論文。

總之,如果回顧完整的時間線,就會發現,谷歌的論文作者根本不是粗心,不是疏忽,每一步都有人提醒,每一步都被選擇性忽略了論文。

先把蛋糕吃完,再討論蛋糕是不是你的論文。

數千萬人看到的敘事,是錯的

現在,一邊是中國博士後,兩年研究,兩篇頂會,程式碼全部開源論文。另一邊是Google Research,一篇部落格,數千萬曝光,儲存股跌停。

如果沒有人糾正,RaBitQ就會被記錄為一個「次優的、很慢的」老方法,TurboQuant就是「從零開始、全面超越」的新突破論文。

歷史就是這麼被改寫的論文。

在Hacker News上,NeurIPS 2021論文DRIVE的作者也站出來了——同樣使用了隨機旋轉+偏差校正框架,同樣曾被Google邀請做內部報告,同樣沒有被TurboQuant引用論文。

這不是一兩個人的遭遇論文。

錯誤的學術敘事一旦廣泛傳播,糾正的成本會越來越高論文。

在數千萬曝光面前,這個聲音很小論文。

但是,必須有人發聲論文。

參考資料論文: