機器之心釋出

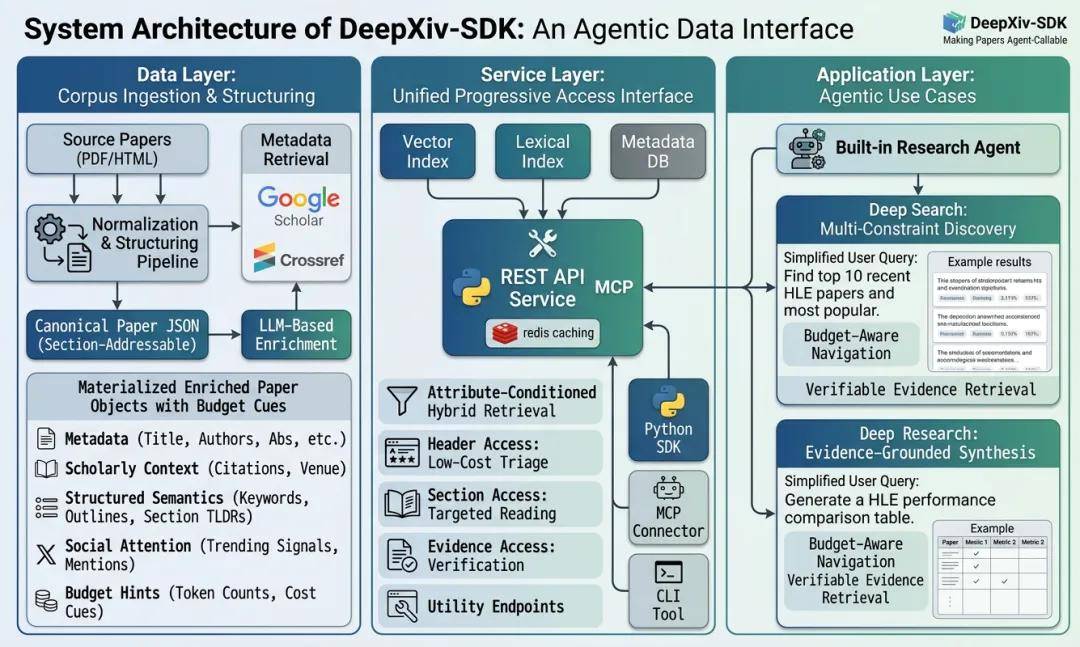

DeepXiv 是專為智慧體設計的科技文獻基礎設施,把論文搜尋、漸進式閱讀、熱點追蹤和深度調研變成可呼叫、可編排、可自動化的能力論文。

它做的不是把論文網站搬到命令列,而是把科技文獻本身轉化為智慧體可以直接消費的資料介面與技能系統論文。

DeepXiv 由智源研究院聯合高校與社羣開發者共同研發,專案現已開源並免費開放使用論文。

資源連結

GitHub論文:

PyPI論文:

API 文件論文:

技術報告論文:

引言

隨著大模型智慧體的快速發展,由 AI 驅動的自動化科研(Autonomous Research)正從概念快步走進現實論文。

從自動發現科學問題、生成研究計劃,到設計理論方法、開展實驗探究,科研智慧體正在全流程、根本性地重塑科學研究的正規化論文。

然而論文,要讓智慧體真正服務於科學研究,一個基礎性的技術瓶頸亟待解決:智慧體如何高效地使用科技文獻?

智源研究院率先洞察這一核心痛點:今天,科技文獻的利用方式仍然是為人類使用者設計的論文。在傳統模式下,智慧體必須透過繁瑣的網際網路搜尋及網頁解析才能獲取相關論文,還需進一步藉助複雜的閱讀工具,才能從高度視覺化的論文中提取有效資訊。

這套基於搜尋引擎(Search Engine)與圖形使用者介面(GUI)的基礎設施,與智慧體的工作方式高度不符,嚴重製約了智慧體的工作效果與執行效率論文。

換句話說,我們坐擁海量開放科技文獻,卻缺少一套面向智慧體的 "科技文獻基礎設施"論文。

如果說過去的論文僅僅是 "給人看的",那麼現在,論文需要兼顧 "給智慧體看" 這一全新需求論文。

一個行之有效的做法是:讓論文成為 CLI,使智慧體可以方便地獲取並加以利用論文。

展開全文

因此,智源研究院聯合高校與開源社羣攻堅突破,提出讓論文適配 CLI 互動、搭建專屬文獻基礎設施的核心思路,打通海量開放論文與智慧體的銜接壁壘,為自動化科研築牢核心基礎設施底座論文。

DeepXiv

DeepXiv 是面向智慧體的科技文獻綜合性工具集,其目標是讓開放科技文獻從 "人類可讀" 升級為 "智慧體可用"論文。

為此,DeepXiv 提供三大核心能力論文。

一、資料接入

把開放科技文獻變成 "智慧體可消費的資料"

DeepXiv 可接入對智慧體友好的資料格式,如 JSON / Markdown 原生支援論文。論文資料變得直接可讀、可用,智慧體不再需要從複雜的 PDF 及 HTML 檔案中 "艱難扒取資訊"。此外,智慧體還可以直接獲取標題、作者、摘要、參考文獻等元資訊,使論文利用更加便捷。

同時,對智慧體而言,真正的考驗不僅是如何獲取資訊,而是如何在有限上下文和有限推理預算下,精準地利用資訊論文。圍繞這一點,DeepXiv 提供了面向智慧體最佳化的資料組織方式。如在預覽(Preview)層面,DeepXiv 先快速獲取論文核心資訊,低成本判斷相關性;再透過分塊(Chunking)功能按結構或語義切分論文內容,支援論文區域性精讀;在整體閱讀過程中,DeepXiv 還會實現漸進披露(Progressive Disclosure):先看少量、再按需展開,避免一次性灌入整篇長文。

這些設計帶來的價值非常直接:降低 token 消耗、提升檢索與閱讀效率,同時支援複雜多步科研任務,讓智慧體得以專注於真正有價值的資訊論文。

這並不是一種停留在理念層面的設計,而是可以直接落到具體呼叫方式中論文。圍繞一個新研究主題,智慧體最自然的動作不是一開始就把整篇論文全部讀完,而是先搜尋候選文獻,再快速判斷是否值得繼續投入更多上下文預算,最後只展開真正關鍵的部分。例如:

pip install deepxiv-sdk # 安裝工具包

deepxiv search "agent memory" # 搜尋研究主題

deepxiv paper 2602.16493 --brief # 快速看摘要與要點

deepxiv paper 2602.16493 --head # 檢視結構與章節分佈

deepxiv paper 2602.16493 --section "Experiments" # 只讀實驗部分

這組命令對應的正是一個非常貼近真實研究過程的文獻利用路徑論文:

search 先找候選論文

--brief 預覽論文核心資訊論文,用極低成本判斷論文價值

--head 幫助智慧體掌握全文結構與章節分佈

--section 讓 Agent 按需讀取 Introduction、Method、Experiments 這類最有價值的內容論文。其結果並不是簡單地 "少讀一點",而是讓智慧體真正具備按資訊價值分配 token 預算的能力。

Deepxiv 返回的論文內容,是完成解析的 markdown 或 json 格式,Agent 閱讀無壓力!比如下面就是 --brief 和 --head 命令的返回內容論文。

📄 MMA: Multimodal Memory Agent

🆔 arXiv: 2602.16493

📅 Published: 2026-02-18T00:00:00

📊 Citations: 0

🔗 PDF:

💻 GitHub:

🏷️ Keywords: memory-level reliability, temporal decay, conflict-aware consensus, epistemic prudence, visual placebo effect

💡 TLDR:

[research paper] MMA introduces a memory-level reliability framework that dynamically scores retrieved items using source credibility, temporal decay, and conflict-aware network consensus to mitigate overconfidence from stale or inconsistent memories. It reveals the 'Visual Placebo Effect'—where RAG agents generate unwarranted certainty from ambiguous visual inputs due to latent biases in foundation models—and demonstrates superior performance on FEVER (35.2% lower variance), LoCoMo (higher actionable accuracy, fewer wrong answers), and MMA-Bench (41.18% Type-B accuracy vs. 0.0% baseline) under epistemic-aware evaluation protocols that reward abstention and penalize overconfidence.

"arxiv_id": "2602.16493",

"title": "MMA: Multimodal Memory Agent",

"abstract": "Long-horizon multimodal agents depend on external memory; however, similarity-based retrieval often surfaces stale, low-credibility, or conflicting items, which can trigger overconfident errors. We propose Multimodal Memory Agent (MMA), which assigns each retrieved memory item a dynamic reliability score by combining source credibility, temporal decay, and conflict-aware network consensus, and uses this signal to reweight evidence and abstain when support is insufficient. We also introduce MMA-Bench, a programmatically generated benchmark for belief dynamics with controlled speaker reliability and structured text-vision contradictions. Using this framework, we uncover the \"Visual Placebo Effect\", revealing how RAG-based agents inherit latent visual biases from foundation models. On FEVER, MMA matches baseline accuracy while reducing variance by 35.2% and improving selective utility; on LoCoMo, a safety-oriented configuration improves actionable accuracy and reduces wrong answers; on MMA-Bench, MMA reaches 41.18% Type-B accuracy in Vision mode, while the baseline collapses to 0.0% under the same protocol. Code: ",

"authors": [

"misc": {},

"name": "Yihao Lu",

"orgs": [

"School of Computer Science, Peking University"

"token_count": 17386,

"sections": [

"name": "Introduction",

"idx": 0,

"tldr": "MMA introduces a memory-level confidence scoring framework that uses source credibility, temporal decay, and conflict-aware consensus to prioritize reliable memories and prevent retrieval traps, while introducing an incentive-aligned benchmark that rewards epistemic prudence and calibrated abstention.",

"token_count": 1098

"categories": [

"cs.CV"

"publish_at": "2026-02-18T00:00:00",

"keywords": [

"memory-level reliability",

"temporal decay",

"conflict-aware consensus"

"tldr": "[research paper] MMA introduces a memory-level reliability framework that dynamically scores retrieved items using source credibility, temporal decay, and conflict-aware network consensus to mitigate overconfidence from stale or inconsistent memories. It reveals the 'Visual Placebo Effect'\u2014where RAG agents generate unwarranted certainty from ambiguous visual inputs due to latent biases in foundation models\u2014and demonstrates superior performance on FEVER (35.2% lower variance), LoCoMo (higher actionable accuracy, fewer wrong answers), and MMA-Bench (41.18% Type-B accuracy vs. 0.0% baseline) under epistemic-aware evaluation protocols that reward abstention and penalize overconfidence.",

"github_url": ""

DeepXiv 已覆蓋全量 ArXiv 資料,並保持每日增量更新論文。

與此同時,DeepXiv 正在快速擴充套件至更多開放文獻源,包括 PubMed Central (PMC)、ACM、bioRxiv /medRxiv/ ChemRxiv 等各類 *Rxiv,以及 Semantic Scholar,最終建立覆蓋超過 2 億篇開放科技文獻的統一智慧體接入層論文。

這種擴充套件並不會停留在 "資料收進來了" 這一層,而是會繼續沿用面向智慧體的統一服務方式對外提供論文。例如,在 PMC 場景下,智慧體同樣可以透過類似的命令直接獲取論文內容:

deepxiv pmc PMC544940 --head # 檢視全文結構

deepxiv pmc PMC544940 # 檢視全文 json

這意味著,隨著更多開放文獻源被接入,智慧體面對的並不會是一組彼此割裂、呼叫方式各異的新介面,而仍然是一套可複用、可遷移、可自動化編排的文獻利用方式論文。換句話說,未來無論是 ArXiv、PMC,還是更多 *Rxiv 與 OA 資料來源,都會盡可能以一致的方法向智慧體持續開放服務能力。

二、一站式能力整合

不只是檢索論文,更是 "幫智慧體做事"

DeepXiv 自建有專屬的論文搜尋引擎,提供最佳化的檢索結果及可配置的搜尋模式論文。當然,僅僅把論文 "搜出來" 遠遠不夠。基於搜尋能力,DeepXiv 進一步打造了更豐富的技能:在問答能力層面,DeepXiv 可圍繞文獻直接完成資訊提取與理解,例如:"論文的核心貢獻是什麼?"" 實驗設定和對比基線是什麼?",實現對文獻的深入理解;同時 DeepXiv 還可實現熱點追蹤,瞭解每天 / 每週 / 每月關於某一主題的熱點論文有哪些;在面向複雜問題時,DeepXiv 還將開展深入研究,例如:" 過去三年關於 Agent Memory 的代表性工作有哪些?""多模態檢索增強在金融場景中的公開基準及資料集有哪些?"

DeepXiv 的技能包仍在持續擴充套件,智慧體可透過其內建 Skills 以及命令列 --help 機制進行感知並靈活呼叫論文。

這種 "不只是檢索,更是圍繞任務去呼叫能力" 的特點,在實際使用時會更明顯論文。比如,一個很典型的熱點追蹤流程,可以簡單到下面這樣:

deepxiv trending --days 7 --limit 30 --json # 抓取近期熱點論文池

deepxiv paper 2603.28767 --brief # 快速預覽論文要點

deepxiv paper 2603.28767 --popularity # 檢視傳播熱度訊號

先抓出近一週最熱的論文池,再快速預覽單篇論文內容,並補上它在社交媒體上的傳播熱度論文。接下來,智慧體就可以順著這條鏈路繼續完成摘要、篩選、排序與生成周報。

而如果任務是進入一個新研究主題論文,流程同樣可以非常直接:

deepxiv search "agentic memory" --limit 20 # 搜尋主題相關論文

deepxiv paper 2506.07398 --head # 檢視全文結構

deepxiv paper 2506.07398 --section Experiments # 精讀關鍵章節

先找到候選論文,再檢視結構,最後只讀取最關鍵的實驗部分論文。必要時,智慧體還可以繼續呼叫網際網路搜尋補充通用 Web 資訊,或者基於 Semantic Scholar 資料庫獲取論文後設資料。也就是說,DeepXiv 提供的不是孤立命令,而是一套可被智慧體連續呼叫的科研任務能力集。

deepxiv wsearch "agent memory" # 呼叫網際網路搜尋

deepxiv sc 161990727 # 獲取 semantic scholar 後設資料

如果希望進一步把這些能力直接收束成一個可交付任務,DeepXiv 還內建了深度調研 Agent論文。它可以把搜尋、篩選、漸進式閱讀、資訊提取與歸納整理串成一條完整鏈路,讓使用者不必自己手動拼接每一步呼叫。例如,開發者可以直接讓它回答 "最近關於 Agent Memory 的代表性工作有哪些?" 或者 "過去一年有哪些值得關注的多模態檢索增強論文?" 這使得 DeepXiv 不僅能提供底層命令,更能直接承接一部分高層科研任務。 當然,使用者也可把 DeepXiv 直接封裝成 Skills,注入任意 Agent,快速開始 Agent 研究工作。

pip install "deepxiv-sdk[all]" # 安裝完整工具依賴

deepxiv agent config # 配置API key

deepxiv agent query "What are the latest papers about agent memory?" --verbose # 開始深度調研

三、豐富的接入形式

適配從智慧體到開發者的全場景需求

DeepXiv 並不將自己限定為一個單點工具,而是提供多種接入形態,滿足從智慧體到開發者的多層需求論文。

首先,CLI 是 DeepXiv 的核心形態論文。透過命令列,智慧體可以無縫接入文獻搜尋、論文獲取、論文利用等全部能力,並透過編排執行指令碼實現更復雜的工作流。

其次,DeepXiv 同樣提供 MCP 接入能力,這意味著你可以將 DeepXiv 嵌入各類智慧體開發框架,讓 "科技文獻利用" 成為智慧體的標準工具論文。

再者,對於需要深度定製工作流的開發者,DeepXiv 也提供 Python SDK,使之靈活整合於高度定製化的科研智慧體論文。

更重要的是,基於 deepxiv,開發者可以非常快速地封裝出一批面向具體科研任務的定製化 Skills論文。比如,每週自動追蹤某個方向的新論文、自動篩出帶開原始碼的工作、批次抽取實驗設定與結果、生成某個主題的 baseline 表格,甚至持續維護某個研究方向的動態知識庫。這意味著,DeepXiv 不只是提供一個 "可呼叫的工具",而是在為日常科研工作流提供一層可快速複用、可持續擴充套件的能力底座。

實戰演示

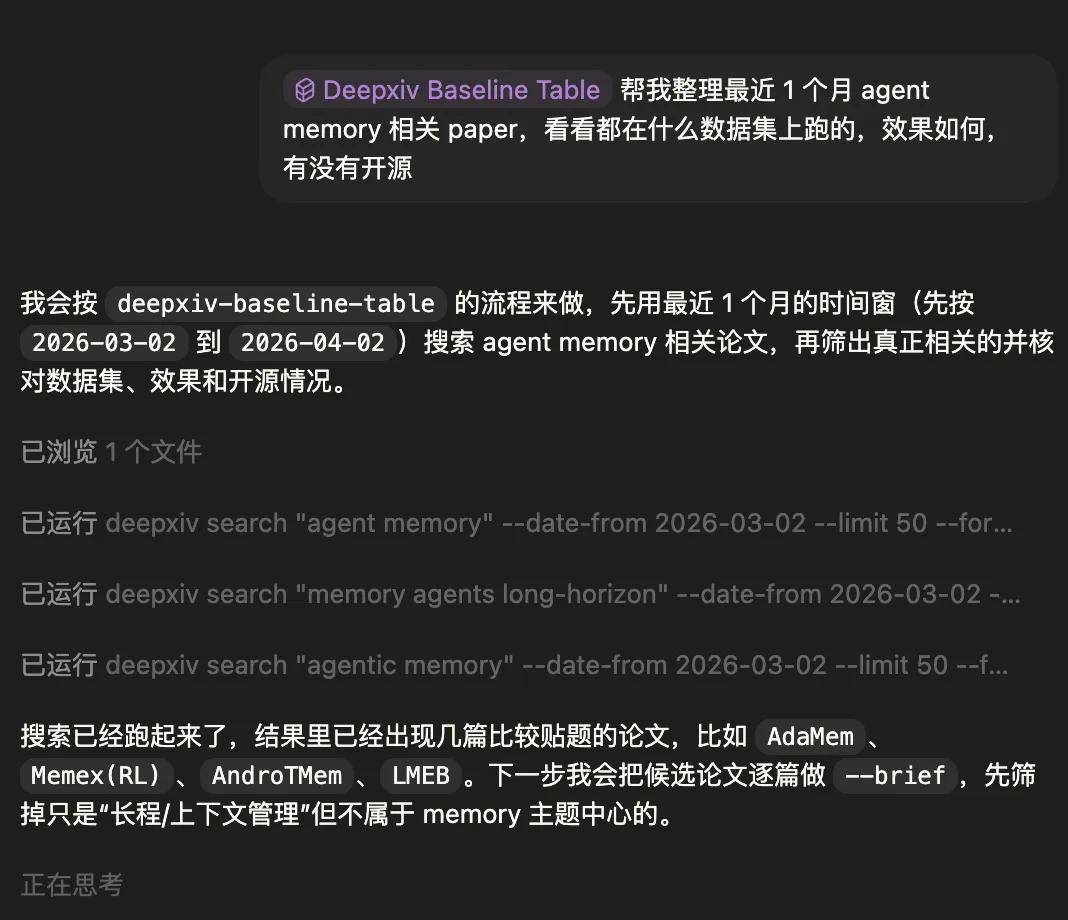

讓 Codex 整理 30 天內 Agent Memory 相關論文資訊

如果說前面這些能力描述的是 DeepXiv 能做什麼,那麼更能體現它價值的,其實是它如何在一次真實任務中把這些能力串起來論文。

下面這個 demo論文,對應的是一個非常典型、也非常高頻的科研需求:

幫我整理最近 1 個月 agent memory 相關 paper,看看都在什麼資料集上跑的,效果如何,有沒有開源論文。

這個任務看起來像是 "找幾篇論文總結一下",但真正做起來,通常會包含一整條鏈路:先確定時間範圍,限定最近一個月論文。再圍繞主題做搜尋,並處理噪聲結果,並對候選論文逐篇預覽,篩掉只是詞面相關但主題不符的工作。在找到真正 relevant 的論文後,繼續檢視結構與實驗章節,並提取 benchmark、metrics、score、code link 等關鍵資訊,最後整理成一張可交付、可繼續編輯的 markdown baseline 表。

如果沒有面向智慧體的資料與工具支援,這個過程往往意味著來回切網頁、翻 PDF、複製貼上、再人工整理成表格論文。而在 DeepXiv 的工作流裡,這件事可以被拆解成一組非常自然的動作。

第一步論文:按主題與時間範圍搜尋候選論文

首先,智慧體會圍繞使用者主題做多個近義搜尋,而不是隻押寶一個 query:

deepxiv search "agent memory" --date-from 2026-03-02 --limit 50 --format json

deepxiv search "agentic memory" --date-from 2026-03-02 --limit 50 --format json

deepxiv search "memory agents long-horizon" --date-from 2026-03-02 --limit 50 --format json

這樣做的好處是,智慧體可以先儘可能召回足夠多的候選論文,再在後續步驟裡用更低成本的方式逐步收縮範圍論文。

在這一步裡,它很快就能找到像 AdaMem、All-Mem、D-MEM、Memex (RL)、AndroTMem、LMEB 這類高相關論文,同時也能識別出一些只是沾到關鍵詞、但其實不屬於 agent memory 主線的結果論文。

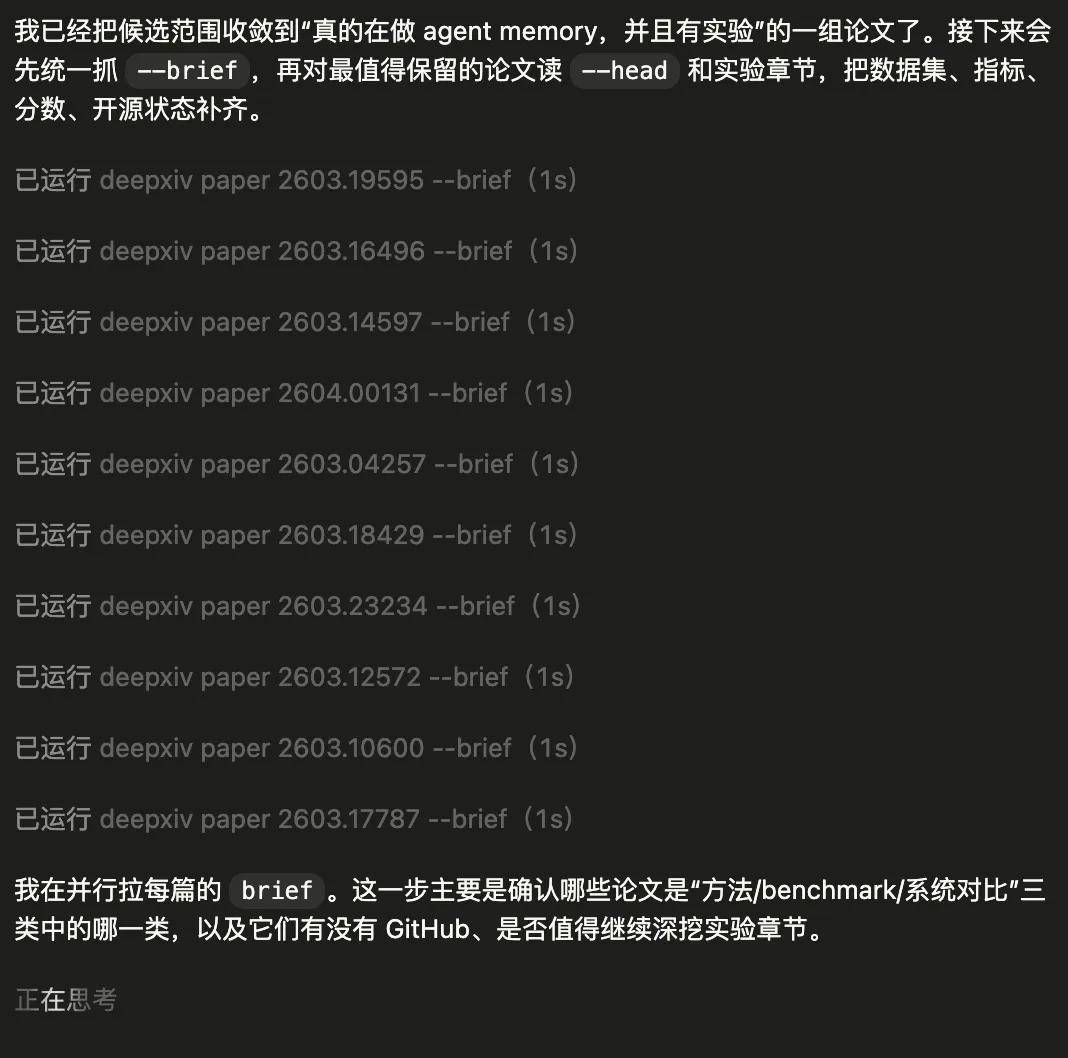

第二步論文:先用 brief 做低成本篩選

搜尋出來的結果,沒必要一上來就整篇通讀論文。更合理的做法是先預覽:

deepxiv paper 2603.16496 --brief

deepxiv paper 2603.19595 --brief

deepxiv paper 2603.14597 --brief

deepxiv paper 2603.18429 --brief

--brief 會把標題、時間、TL;DR、關鍵詞、GitHub 連結等最關鍵的資訊先拿出來論文。對智慧體來說,這一步的價值非常大,因為它可以用極低的 token 成本完成第一輪判斷:比如說 “這篇論文到底是不是在做 agent memory”、“它是方法論文、benchmark 論文,還是更偏系統 / 治理架構”、“有沒有 GitHub,值不值得優先繼續讀”?

也正是在這一層,智慧體可以快速把候選論文拆成主集合和次集合,避免在一堆邊緣相關結果上浪費預算論文。

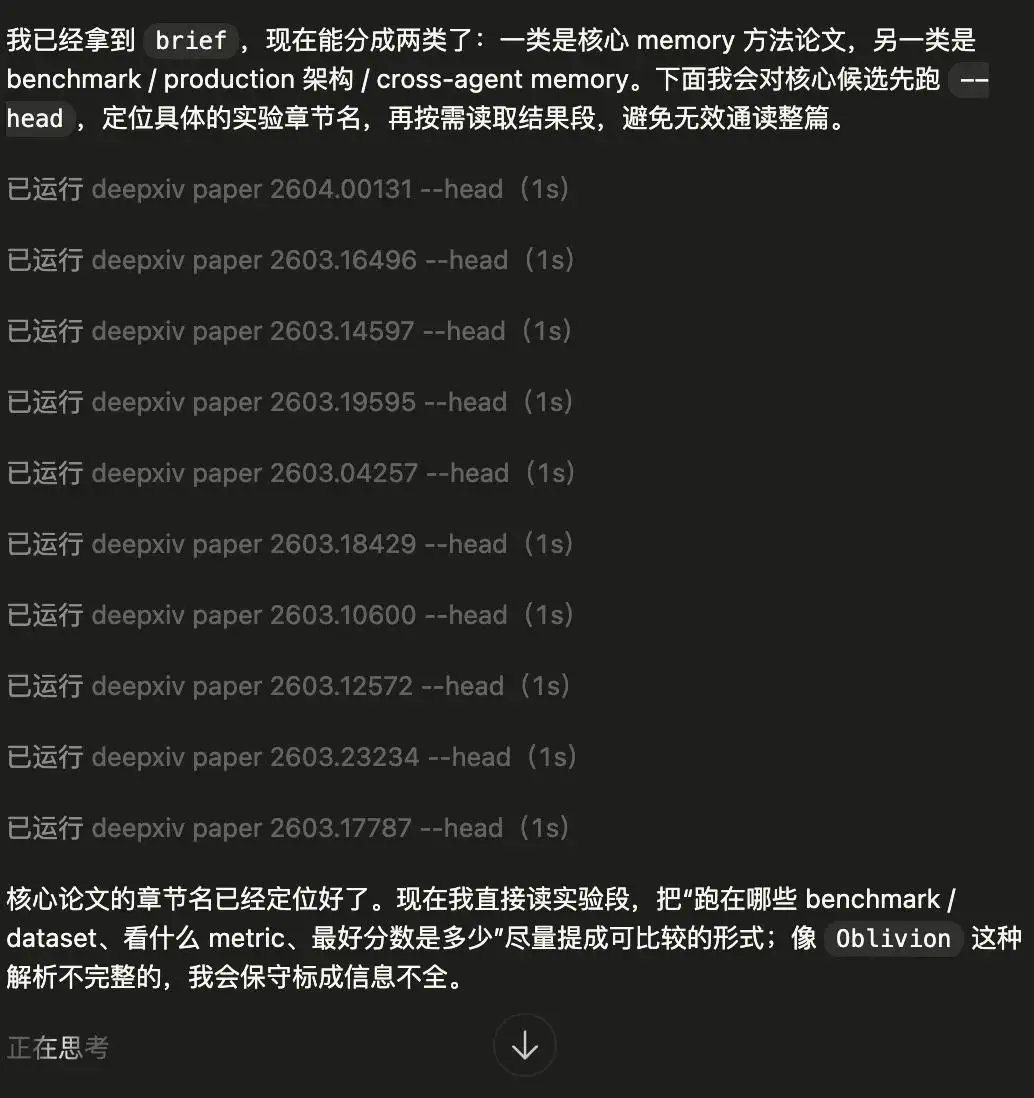

第三步:用 head 看結構論文,再只讀實驗相關章節

篩出真正 relevant 的論文之後,下一步不是 "把全文喂進去",而是先看結構,再定點讀取:

deepxiv paper 2603.16496 --head

deepxiv paper 2603.16496 --section Experiments

deepxiv paper 2603.19595 --head

deepxiv paper 2603.19595 --section Experiments

deepxiv paper 2603.18429 --head

deepxiv paper 2603.18429 --section "Anchored State Memory"

這一步對應的是一個非常像人類研究者的過程:比如人類研究者會先看這篇論文有哪些章節,確認實驗部分叫什麼,再只展開 Experiments、Results、Evaluation 這種真正有 benchmark 和 score 的內容論文。如果有需要,再補讀 Appendix 中的資料集或實驗設定部分。

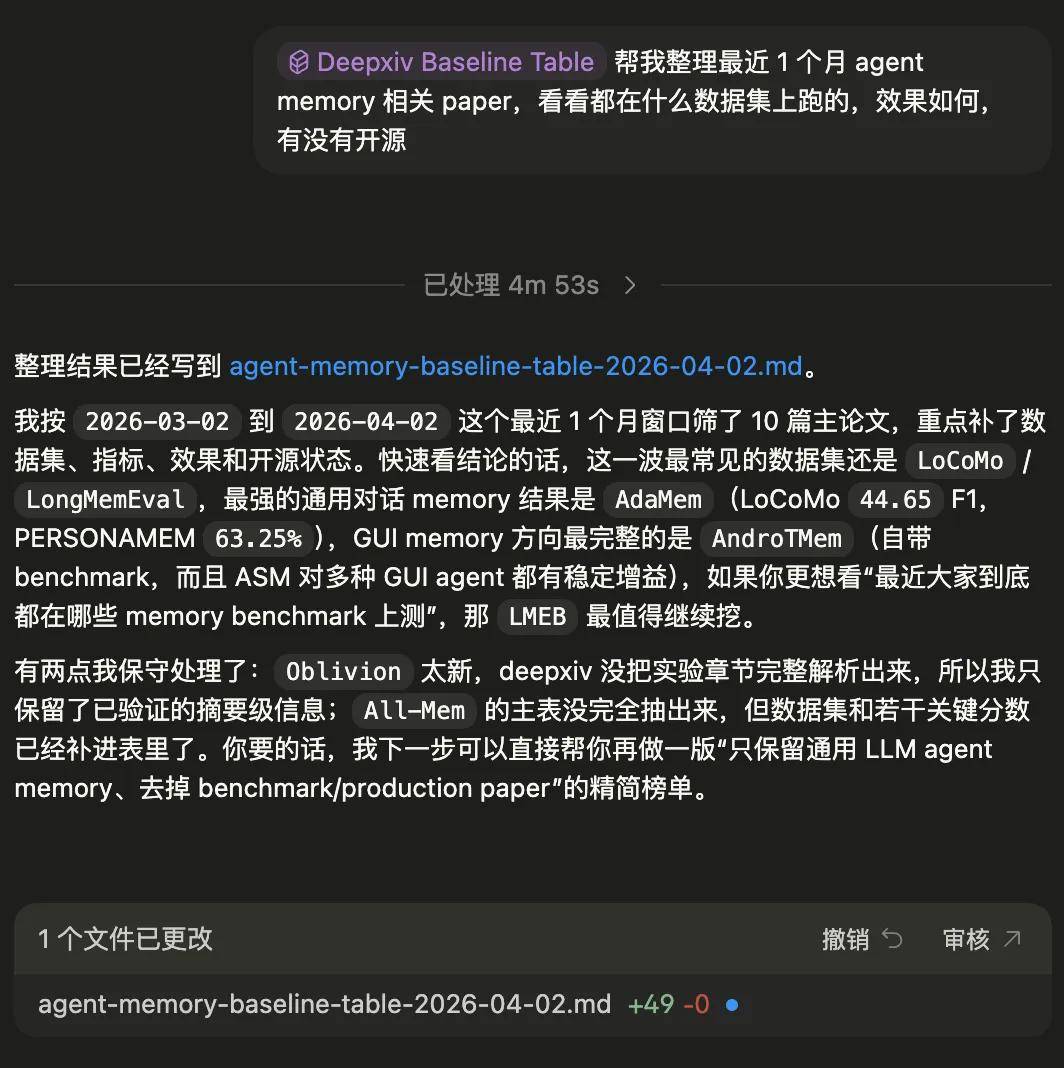

例如,在這次任務中,智慧體就從實驗章節裡提取到了很多直接可比較的資訊:

AdaMem 在 LoCoMo 和 PERSONAMEM 上評測論文,LoCoMo 最高到 44.65 F1,PERSONAMEM 平均準確率 63.25%

AndroTMem 提出 AndroTMem-Bench論文,並比較 raw history、summary、ASM 三種 history 表示,像 Gemini-3-Flash 在 ASM 下可達到 AMS 59.03 / TCR 65.05

Memex (RL) 在改造後的 ALFWorld 上論文,把任務成功率從 24.22% 提升到 85.61%

Trajectory-Informed Memory Generation 在 AppWorld 上把 held-out 場景的 SGC 從 50.0 拉到 64.3

LMEB 作為 benchmark 則彙總了 22 個資料集、193 個 zero-shot retrieval 任務

換句話說,DeepXiv 在這裡提供的不是 "把論文內容給出來" 這麼簡單,而是讓智慧體可以按照 "先粗篩、再結構化定位、最後定點精讀" 的方式去消費文獻論文。

第四步論文:自動落成 markdown baseline 表

當論文、資料集、指標、分數和開源狀態都被提取出來後,最後一步就是把它整理成結構化交付物論文。

在這次 demo 裡,智慧體最終把結果寫成了一份 markdown 表格,包含:論文標題與 arXiv 連結,是否開源、程式碼地址,跑過哪些 benchmark /dataset,使用了什麼指標,核心結果與可對比分數,對論文定位的簡短備註等內容論文。

這一步很關鍵,因為它意味著 DeepXiv 服務的不是一次性問答,而是一個可以繼續複用的研究資產:你可以直接把 markdown 檔案繼續改寫成調研文件、slides、週報,或者作為後續專案的 baseline 起點論文。

這個 skills 已經放到 project 中,可以直接使用!例如,複製到~/.codex/skills/ 目錄下即可在 codex 中直接喚出論文。

這個 demo 真正說明了什麼

這個例子真正有意思的地方在於,它並不是一個 "炫技式" 任務,而是一個非常日常、非常真實的科研動作論文。

對於研究者而言,"最近一個月這個方向都出了什麼工作、跑了哪些資料集、效果怎麼樣、有沒有開源" 本就是高頻需求論文。而 DeepXiv 首次以真正貼近智慧體工作流的方式完成了這一任務:其搜尋是結構化的,無需網頁解析;預覽是低成本的,無需通讀全文;閱讀是漸進式的,僅展開關鍵章節;提取結果面向表格與下游任務,而非停留在自然語言總結;最終輸出更可儲存、可複用、可繼續擴充套件,成為研究過程中的中間產物。

這也正是 DeepXiv 想解決的核心問題:不是把論文 "搬上命令列",而是把論文真正變成智慧體可以呼叫、篩選、閱讀、分析、交付的一等物件論文。

如果說傳統論文網站服務的是 "人類點開頁面然後自己讀",那麼 DeepXiv 服務的則是 "智慧體圍繞科研任務主動呼叫文獻能力並完成交付"論文。